Leichte Sprachmodelle haben sich von Nischenforschungsprojekten zu unverzichtbaren Werkzeugen für Ingenieure, Start-ups und Unternehmen entwickelt, die schnelle, zuverlässige KI ohne die schwerfällige Infrastruktur riesiger Modelle benötigen. Die besten leichten LLMs im Jahr 2026 sind nicht mehr nur „kleinere Versionen” großer Systeme. Es handelt sich um speziell entwickelte Maschinen, die auf kurze Latenzzeiten, geringen Stromverbrauch und effizientes Denken ausgelegt sind.

Ganz gleich, ob Sie einen Programmierassistenten entwickeln, KI am Rand einsetzen oder einfach nur versuchen, mehr Leistung aus Mittelklasse-Hardware herauszuholen – leichte Modelle sind heute in der Lage, Aufgaben zu übernehmen, für die früher massive GPU-Cluster erforderlich waren. Unter den besten leichten LLMs im Jahr 2026 stechen drei Modelle aufgrund ihrer Leistung in der Praxis besonders hervor: Mistral 7B, Phi-3 und Claude Haiku.

Bevor wir uns näher damit befassen, hier ein kurzer Überblick über diese Systeme und was jedes einzelne davon so besonders macht.

Wichtige leichtgewichtige LLMs, die man 2026 kennen sollte (kurze Hinweise)

1. Mistral 7B

- Bekannt für eine der schnellsten Inferenzgeschwindigkeiten in der 7B-Klasse.

- Hervorragend geeignet für Edge-Bereitstellungen, Chat-Systeme, mehrsprachige Texte und schnelle Codierungsaufgaben.

- Ideal für Teams, die konsistente Genauigkeit bei minimalen GPU-Kosten benötigen.

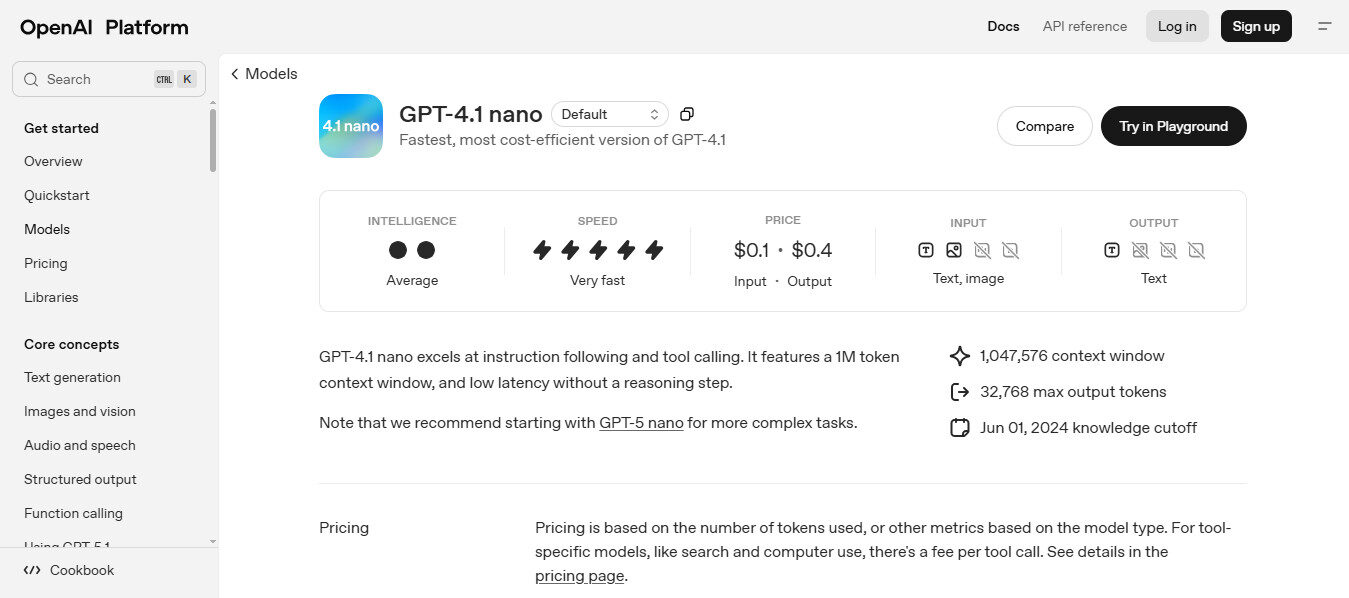

2. OpenAI’s GPT-4 Nano

- Entwickelt für extreme Effizienz, insbesondere für mobile und eingebettete Systeme

- Starke Mikro-Modell-Argumentation, ideal für On-Device-Intelligenz und Anwendungen mit geringer Latenz

3. Gemma 2B & Gemma 7B (Google)

- Saubere Anweisungen mit minimaler Abweichung

- Hochgradig optimiert für Verbraucherhardware und lokale Entwicklungsumgebungen

4. Meta’s Llama 3 Series

- Großes Open-Source-Ökosystem mit hervorragender Unterstützung für Feinabstimmungen

- Leistet gute Arbeit bei mehrsprachigen Aufgaben, generativen Arbeitsabläufen und der Erstellung von leichtgewichtigem Code

5. Microsoft Phi-3 Series

- Läuft reibungslos auf Mittelklasse-CPUs und Consumer-GPUs.

- Kompakt, aber mit starker Schlussfolgerungsfähigkeit.

- Ideal für Unternehmens-Tools, lokale Bereitstellungen und beste leichtgewichtige LLM-Modelle für die Codierung.

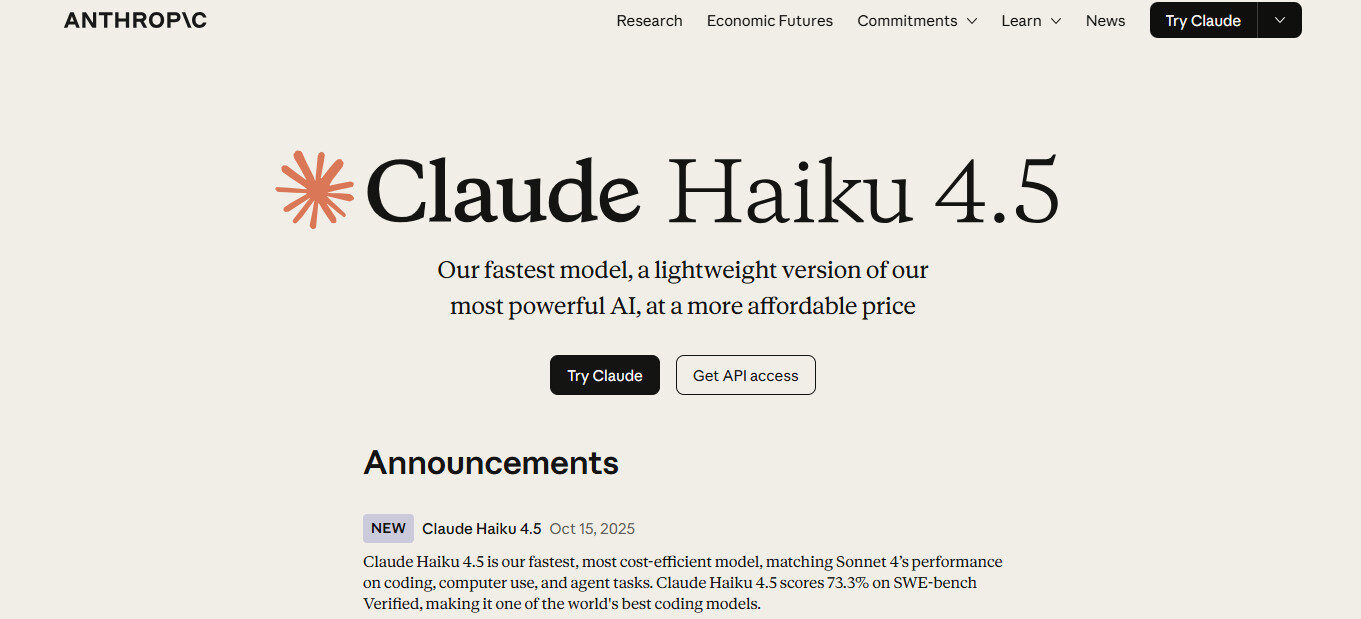

6. Claude Haiku

- Das schnellste Modell der Claude 3-Familie.

- Hervorragend geeignet für leichtgewichtiges Schlussfolgern, Q&A-Systeme und kosteneffiziente Automatisierung.

- Äußerst zuverlässig für Kundensupport, Zusammenfassungen und schnelle Interpretationsaufgaben.

Was sind leichtgewichtige LLMs?

Leichte LLMs sind kompakte Sprachmodelle, die zuverlässige Schlussfolgerungen und natürliche Textgenerierung ohne die hohen Rechenanforderungen großer Systeme liefern sollen. Anstatt auf maximale Größe oder Komplexität zu setzen, konzentrieren sich diese Modelle auf Effizienz. Sie laufen reibungslos auf alltäglicher Hardware, einschließlich Laptops der Mittelklasse, Mobilgeräten und Edge-Umgebungen, in denen Speicher und Leistung begrenzt sind. Ihr Zweck ist praktisch: Sie geben Entwicklern und Unternehmen die Möglichkeit, KI in Tools, Apps und Workflows zu integrieren, ohne auf teure Server oder einen ständigen Cloud-Zugang angewiesen zu sein.

Trotz ihrer geringeren Größe können moderne Lightweight-Modelle Anweisungen verstehen, Informationen zusammenfassen, bei der Programmierung helfen und Konversationsaufgaben mit überraschender Genauigkeit unterstützen. Sie eignen sich besonders für Offline-Anwendungen, datenschutzrelevante Vorgänge und Produkte, die schnelle Reaktionszeiten erfordern. In vielen Fällen bieten sie die ausgewogenste Kombination aus Geschwindigkeit, Kosten und Anpassungsfähigkeit für den Einsatz in der Praxis.

Warum leichte LLMs im Jahr 2026 wichtig sind

Da Modelle mittlerweile mehrere hundert Milliarden Parameter umfassen, sind Kosten und Zugänglichkeit zu entscheidenden Herausforderungen geworden. Unternehmen legen zunehmend Wert auf:

- Geringere Betriebskosten

- Verkürzte Inferenzzeit

- Lokale Bereitstellungsmöglichkeiten

- Bessere Datenschutz- und Datenkontrolle

- Energieeffiziente Leistung

Diese Veränderung erklärt, warum die Suchanfragen nach den besten leichtgewichtigen LLMs im Jahr 2026 deutlich zugenommen haben. Diese Modelle dienen nun als Rückgrat für Chatbots, Codierungsagenten, Support-Tools, IoT-Systeme und Multi-Agent-Anwendungen, die Zuverlässigkeit ohne Komplexität erfordern.

Tiefgehende Analyse der besten leichtgewichtigen LLMs im Jahr 2026

Nachfolgend finden Sie eine detaillierte Aufschlüsselung der einzelnen Modelle, ihrer Funktionsweise und ihrer jeweiligen Stärken. Dabei geht es nicht darum, Marketingaussagen zu wiederholen, sondern eine fundierte, technische Sichtweise auf der Grundlage der aktuellen Branchenpraxis und Testdaten zu bieten.

Mistral 7B dominiert weiterhin die Diskussion um die besten leichtgewichtigen LLMs im Jahr 2026. Die Effizienz des Modells ist kein Zufall, sondern das Ergebnis sorgfältiger architektonischer Entscheidungen, einer strengen Kuratierung der Trainingsdaten und einer umfassenden Optimierung der Anweisungen.

- Läuft effizient auf einer einzigen Consumer-GPU.

- Liefert stabile Schlussfolgerungen ohne starke Abweichungen oder Halluzinationen.

- Verfügt über eine starke Mehrsprachenunterstützung, insbesondere für europäische Sprachen.

- Wird häufig als Basismodell für fein abgestimmte Unternehmens-Chatbots verwendet.

Der Tokenizer und die Trainingsoptionen von Mistral tragen ebenfalls dazu bei, dass es ältere Modelle ähnlicher Größe in den Bereichen Codierung, Übersetzung und domänenspezifisches Schreiben übertrifft. Viele Entwickler vertrauen bei Codierungsaufgaben auf Mistral als bestes leichtgewichtiges LLM-Modell, da seine schrittweisen Ergebnisse sauber und konsistent sind.

- Automatisierung des Kundensupports

- Lokale RAG-Systeme

- Browserbasierte Assistenten

- Coding-Helfer mit geringer Latenz

- Tools zur Workflow-Orchestrierung

Kurz gesagt: Mistral bleibt eine sichere, berechenbare Option, wenn es auf Geschwindigkeit und Stabilität ankommt.

2. GPT-4 Nano von OpenAI: Ein neuer Standard für mobile KI

GPT-4 Nano markiert OpenAIs Vorstoß in Richtung hocheffizienter Modelle, die dennoch ein hohes Maß an Zuverlässigkeit beim Schlussfolgern beibehalten. Im Gegensatz zu größeren Versionen der GPT-4-Familie ist Nano speziell auf Geräte abgestimmt, bei denen Leistungsgrenzen, thermische Einschränkungen und Speicherbegrenzungen echte Hindernisse für den Einsatz darstellen.

Was macht GPT-4 Nano so wichtig?

- Es wurde für Smartphones, Tablets, Wearables und IoT-Systeme entwickelt.

- Bietet eine präzise Reaktionssteuerung und eignet sich daher für Anwendungen, bei denen Sicherheit an erster Stelle steht.

- Liefert trotz seiner geringen Größe leistungsstarke Schlussfolgerungen.

- Ideal für Apps, die Datenschutz erfordern, da die Verarbeitung auf dem Gerät verbleiben kann.

Entwickler, die an Verbraucheranwendungen arbeiten, bevorzugen Nano, da es Echtzeitberechnungen bei sehr geringem Energieverbrauch ermöglicht. Seine Leistung bei kurzen Denkaufgaben, Routing-Abfragen und persönlichen Assistenz-Workflows macht es zu einem der stillen, aber wichtigen Konkurrenten im Bereich der besten leichtgewichtigen LLMs im Jahr 2026.

3. Gemma 2B & Gemma 7B: Googles Fokus auf saubere, kompakte Intelligenz

Gemma-Modelle wurden mit einem Ziel entwickelt: klare, kontrollierte und vorhersehbare Ergebnisse zu liefern, ohne dass dafür leistungsstarke Hardware erforderlich ist. Beiden Hauptvarianten, 2B und 7B, richten sich an unterschiedliche Zielgruppen. Die 2B-Version ist außergewöhnlich leicht und eignet sich perfekt für Einstiegsexperimente oder mobile KI. Die 7B-Version bietet leistungsstärkere Schlussfolgerungen für Forschungs-, Automatisierungs- und Codierungsaufgaben.

Warum Gemma-Models herausstechen

- Sehr starke Anweisungsausrichtung im Vergleich zu anderen Modellen ähnlicher Größe.

- Saubere Satzstruktur mit minimaler Übergenerierung.

- Läuft reibungslos auf GPUs der Mittelklasse und Laptops der Mittelklasse.

- Gute Wahl für lokales RAG, Bildungswerkzeuge und leichte Analyse-Workloads.

Gemma hat sich schnell zu einem Favoriten unter Entwicklern entwickelt, die ein Gleichgewicht zwischen geringer Größe und zuverlässiger Befehlsausführung suchen. Dank seiner Effizienz fügt es sich nahtlos in Arbeitsabläufe ein, die zuvor stark von viel größeren Systemen abhängig waren.

5. Meta’s Llama 3: Das Open-Source-Rückgrat von 2026

Die Llama 3-Serie von Meta erweitert die Liste der besten leichtgewichtigen LLMs im Jahr 2026 um eine wichtige Dimension, da sie sowohl Skalierbarkeit als auch Community-Support bietet. Die kleineren Varianten bieten eine starke Basisargumentation, während das breitere Ökosystem Feinabstimmung, multimodale Nutzung und Anpassung an benutzerdefinierte Domänen unterstützt.

Warum Llama 3 weiterhin Einfluss hat

- Die große Open-Source-Community erleichtert die Integration.

- Der Support für Feinabstimmungen ist besser als bei den meisten proprietären Modellen.

- Gute Mehrsprachigkeit und strukturiertes Schreiben.

- Wird häufig für interne Unternehmensanwendungen gewählt, bei denen Anpassungen wichtig sind.

Der größte Vorteil von Llama 3 besteht darin, wie einfach Entwickler es zu domänenspezifischen Modellen formen können. Branchen, die auf maßgeschneiderte Sprachsysteme angewiesen sind – Gesundheitswesen, Finanzwesen, Logistik und Politikforschung – profitieren von der Flexibilität und Transparenz, die es bietet.

5. Phi-3: Microsofts Durchbruch im Bereich kompaktes Schlussfolgern

Phi-3 ist eines der meistdiskutierten Modelle unter den Top-Lightweight-LLMs im Jahr 2026. Es wurde so konzipiert, dass es auf handelsüblichen Laptops, Mid-Tier-GPUs und sogar einigen mobilen Geräten ohne größere Qualitätseinbußen läuft.

Warum Phi-3 zu einem Wendepunkt wurde

- Intensive Nutzung synthetischer Datensätze für Schlussfolgerungen

- Hervorragende Leistung der Gedankenkette für seine Größe

- Sehr geringe VRAM-Anforderungen

- Erhältlich in mehreren Varianten, die für Chat, Programmierung und Schlussfolgerungen optimiert sind

Phi-3 zählt durchweg zu den besten leichtgewichtigen LLM-Modellen für die Codierung, da es Anweisungen klar versteht und strukturell einwandfreien Code ausgibt.

Bevorzugte Anwendungsfälle

- Offline-Persönliche Assistenten

- Unterrichtsmittel für den Klassenraum

- Wissenschaftliche Taschenrechner und Argumentations-Bots

- Edge-fähige Industrieanwendungen

Dank seiner kompakten Bauweise ist es eines der zugänglichsten Modelle des Jahres.

6. Claude Haiku: Geschwindigkeit über alles

Claude Haiku ist das schnellste und wirtschaftlichste Mitglied der Claude-Familie. Obwohl es im Vergleich zu Sonnet oder Opus klein ist, liefert es bemerkenswerte Leistung bei Aufgaben, die Geschwindigkeit erfordern, ohne dabei an Zuverlässigkeit einzubüßen.

Was macht Haiku so besonders?

- Blitzschnelle Inferenzgeschwindigkeiten

- Hervorragende sachliche Genauigkeit bei kurzen Aufgaben

- Überraschend starkes logisches Denken trotz Größe

- Anpassungsfähigkeit an Szenarien mit erweiterter Abfrage

Wenn Sie einen Support-Bot, eine Empfehlungsmaschine oder einen leichtgewichtigen Automatisierungsagenten entwickeln möchten, liefert Haiku sofortige und konsistente Ergebnisse. Es bleibt eine erste Wahl unter Unternehmen, die nach den besten leichtgewichtigen LLMs im Jahr 2026 suchen, da es Geschwindigkeit mit hochwertigen Antworten kombiniert.

Vergleich: Die besten leichtgewichtigen LLMs im Jahr 2026

| Modell | Stärke | Bester Anwendungsfall | Hardware-Anforderungen |

| Mistral 7B | Ausgewogene Geschwindigkeit und Argumentation | Chatbots, RAG, Programmierung | Niedrig |

| GPT-4 Nano | Hohe Genauigkeit für seine Größe | Mobile KI, eingebettete Apps | Sehr niedrig |

| Gemma 2B / 7B | Saubere Ergebnisse, starke Anweisungsoptimierung | Lokale Tools, Forschung | Niedrig |

| Llama 3 | Offenes Ökosystem | Feinabstimmung mehrsprachiger Apps | Mittel |

| Phi-3 | Beste Hardware-Effizienz | Edge-Bereitstellungen, Apps | Sehr niedrig |

| Claude Haiku | Schnellste Ausführung | Unterstützungssysteme, Routing | Cloud-API |

Die Wahl des richtigen Leichtbaumodells

Die Auswahl aus den besten leichtgewichtigen LLMs im Jahr 2026 hängt davon ab, was Sie priorisieren:

Wenn Geschwindigkeit am wichtigsten ist:

Claude Haiku

Wenn die Genauigkeit der Codierung entscheidend ist:

Phi-3 or Mistral 7B (both are among the best lightweight LLM models for coding)

Wenn Sie einen Durchsatz im Cloud-Maßstab benötigen:

Mistral 8x7B

Wenn Sie eine lokale Bereitstellung wünschen:

Phi-3 or Mistral 7B

Wenn die Kosten das Hauptanliegen sind:

Phi-3 (läuft auch auf Geräten mit geringer Leistung) Das ideale Modell hängt stark vom Kontext, der Qualität des Datensatzes und davon ab, ob Feinabstimmungen Teil Ihres Arbeitsablaufs sind.

Wenn Kosten und Hardware-Effizienz die Hauptanliegen sind:

Phi-3 oder Gemma 2B (Sie funktionieren auch auf Einstiegs-GPUs und -CPUs zuverlässig.)

Wenn Sie das beste Open-Source-Ökosystem möchten:

Llama 3 (Starke Community-Unterstützung und hervorragend für fein abgestimmte Unternehmenslösungen geeignet.)

Wenn Sie mobile oder eingebettete Anwendungen entwickeln:

GPT-4 Nano oder Gemma 2B (Diese wurden speziell für minimalen Speicher- und Stromverbrauch entwickelt.)

Was macht ein gutes leichtgewichtiges LLM im Jahr 2026 aus?

Ein wirklich effektives Leichtbaumodell sollte vier Kernstandards erfüllen:

1. Geringe Latenz

Die Inferenzgeschwindigkeit ist ein wichtiges Unterscheidungsmerkmal. Die besten leichtgewichtigen Modelle reagieren innerhalb von Millisekunden.

2. Effiziente Speichernutzung

Modelle wie Phi-3 können mit 4 bis 8 GB VRAM betrieben werden und eignen sich daher ideal für die geräteinterne KI.

3. Anpassungsfähigkeit

Feinabstimmungsfunktionen, Kompatibilität mit RAG und eine starke Befehlsausführung sind in praktischen Umgebungen erforderlich.

4. Zuverlässigkeit

Leichtgewicht bedeutet nicht geringe Qualität. Die Top-Modelle antworten konsistent und behalten bei kurzen Eingaben ihre sachliche Korrektheit bei.

Wo leichte LLMs heute eingesetzt werden

Der Anstieg der Akzeptanz im Jahr 2026 wird durch reale betriebliche Anforderungen vorangetrieben:

Codierungsagenten

- Viele Entwickler verwenden Mistral, Phi-3 oder Haiku, um Code zu generieren, zu analysieren und zu debuggen.

KI-Geräte für Verbraucher

- Intelligente Notebooks, AR-Brillen und eingebettete Sensoren basieren auf Modellen wie Phi-3.

Unternehmensworkflows

- Leichte Modelle werden in CRM-Systemen, internen Suchwerkzeugen und der Dokumentenautomatisierung eingesetzt.

Kundensupport

- Haiku dominiert dieses Segment aufgrund seiner schnellen Reaktionszeit und geringen Kosten.

Bildung

- Lokal ausgeführte Modelle helfen bei Nachhilfe, MINT-Erklärungen und interaktiven Lerntools.

- Die Vielseitigkeit der besten leichtgewichtigen LLMs im Jahr 2026 zeigt, wie schnell sich die KI-Welt in Richtung Effizienz verändert hat.

Abschließende Gedanken

Der Wettbewerb unter den leichtgewichtigen Modellen ist härter denn je. Kompakte Architekturen entwickeln sich so schnell, dass sie die Leistungsfähigkeit der großen proprietären Systeme des letzten Jahres in Frage stellen. Ganz gleich, ob Sie Kosten optimieren, schnelle Interaktion erwarten oder KI auf kleinen Geräten ausführen möchten – Sie haben eine solide Auswahl aus Open-Source- und proprietären Ökosystemen.

Solange Sie Ihre Workload und Leistungserwartungen klar definieren, finden Sie in der heutigen Landschaft der besten leichtgewichtigen LLMs im Jahr 2026 das richtige Modell für sich.

FAQs

Was sind leichtgewichtige LLMs und warum sind sie im Jahr 2026 so wichtig?

Es handelt sich um kleinere KI-Modelle, die auf Geschwindigkeit und geringen Hardware-Bedarf ausgelegt sind. Im Jahr 2026 sind sie wichtig, weil Unternehmen schnelle, erschwingliche und private KI-Lösungen wünschen, die lokal ausgeführt werden können, anstatt auf große Cloud-Systeme angewiesen zu sein.

Welches leichtgewichtige LLM eignet sich am besten für die Programmierung?

Mistral 7B und Microsoft Phi-3 stechen besonders hervor. Sie generieren sauberen Code, befolgen Anweisungen gut und laufen reibungslos auf Hardware der Mittelklasse.

Was ist das beste leichtgewichtige Modell für mobile oder eingebettete Geräte?

GPT-4 Nano ist die stärkste Option. Es wurde für knappe Strom- und Speicherressourcen entwickelt und eignet sich daher ideal für Telefone, Wearables und IoT-Anwendungen.

Welches leichtgewichtige LLM ist am budgetfreundlichsten?

Phi-3 bietet das beste Preis-Leistungs-Verhältnis. Es läuft gut auf CPUs und GPUs mit niedrigen Spezifikationen und hilft Teams, die Kosten niedrig zu halten, ohne an Qualität einzubüßen.

Wie wähle ich das richtige leichtgewichtige Modell aus?

Wählen Sie entsprechend Ihrer Prioritäten: Haiku für Geschwindigkeit, Phi-3 oder Gemma 2B für kostengünstige lokale Nutzung, Mistral 7B für ausgewogene Genauigkeit, GPT-4 Nano für mobile Apps und Llama 3, wenn Sie Open-Source-Flexibilität wünschen.